論文解説 大規模言語モデルLLMを使った動画生成AI

タイトル: LLM-grounded Video Diffusion Models

著者: Long Lian, Baifeng Shi, Adam Yala, Trevor Darrell, Boyi Li

論文のURL: https://arxiv.org/abs/2309.17444

この論文の解説です。

論文発表日:

29 Sep 2023

論文発表日:

29 Sep 2023

専門外の人でも分かるような説明

この研究は、テキストを基にして動画を生成するための新しい方法を提案しています。具体的には、大規模な言語モデルを使用して、テキストから動画のレイアウトを生成し、そのレイアウトを基にして動画を生成する方法を紹介しています。

要約

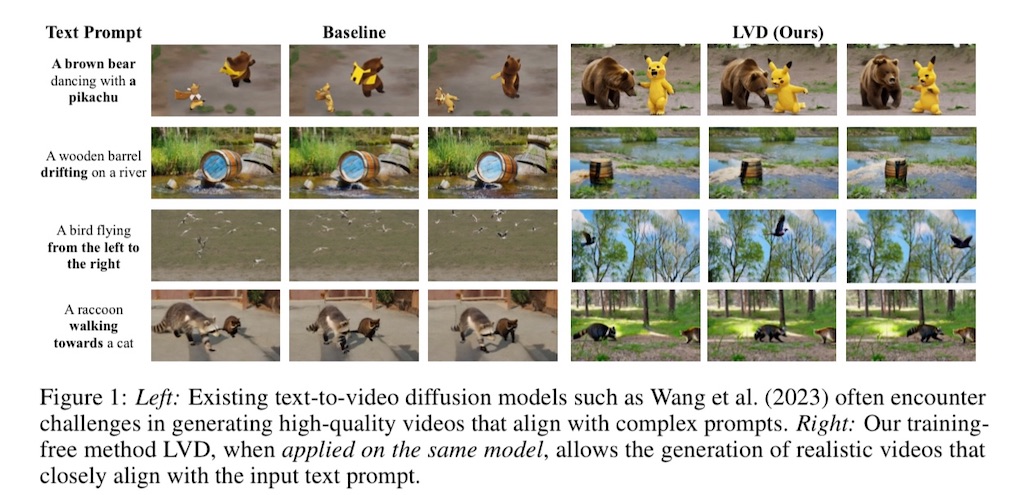

テキスト条件付きの拡散モデルは、ニューラルビデオ生成の有望なツールとして登場しています。しかし、現在のモデルは、複雑な空間的・時間的なプロンプトに苦労しており、しばしば制限されたまたは誤った動きを生成します。これらの制限を解決するために、LLM-grounded Video Diffusion (LVD)を導入します。LVDは、テキスト入力から直接ビデオを生成するのではなく、まず大規模な言語モデルを使用してテキスト入力に基づいて動的なシーンレイアウトを生成し、その後、生成されたレイアウトをガイドとして拡散モデルでビデオを生成します。我々のアプローチは、トレーニングフリーであり、任意のビデオ拡散モデルに統合することができます。結果として、LVDは、所望の属性と動きのパターンを持つビデオを忠実に生成する点で、基本的なビデオ拡散モデルといくつかの強力なベースライン方法を大幅に上回っています。

従来とは異なるこの論文の新しい点

この研究は、テキストから動画のレイアウトを生成するための新しいアプローチ、LLM-grounded Video Diffusion (LVD)を紹介しています。LVDは、テキスト入力から直接ビデオを生成するのではなく、大規模な言語モデルを使用して動的なシーンレイアウトを生成し、そのレイアウトを基にしてビデオを生成するという新しい方法を提案しています。

課題点

- 現在のテキスト条件付きの拡散モデルは、複雑な空間的・時間的なプロンプトに苦労しており、しばしば制限されたまたは誤った動きを生成する。

- テキストからの動画生成における正確性と信頼性の向上が必要です。

| 深層学習教科書 ディープラーニング G検定(ジェネラリスト)公式テキスト 第2版 (EXAMPRESS) [ 一般社団法人日本ディープラーニング協会 ] 価格:3,080円 |

![]()